在人工智能技術熱潮的推動下,全球AI算力需求激增,AI服務器市場也隨之進入了快速擴張階段。

AI服務器主要用于處理深度學習工作負載所需的海量數據,尤其是在訓練和推理過程中,涉及大內存容量、高帶寬和系統內緩存一致性等關鍵需求。與普通服務器相比,AI服務器通常采用“異構形式”,具備更強的計算能力、更快的處理速度和更大的存儲空間,從而能夠高效支持高負載和復雜的計算任務。

傳統服務器市場每年出貨量約為1200萬臺,市場規模達1200億美元。與之相較,AI服務器由于具備更高的單機價值和算力需求,展現出遠遠超越傳統服務器的市場潛力。

作為算力的“發動機”,AI服務器的需求正在呈現爆發式增長。根據Counterpoint Research發布的最新報告,2024年第二季度全球服務器市場收入同比增長了35%,達到454.22億美元。其中,AI服務器的收入占比已提升至19%。

AI服務器市場,根據IDC的預測,2023年全球AI服務器市場規模預計達到211億美元,預計到2025年將突破317億美元,2023至2025年的年均增長率(CAGR)將達到22.7%。從國內市場看,2024年上半年加速服務器市場規模預計達到50億美元,同比增長63%。其中,GPU服務器繼續占據主導地位,市場規模為43億美元,而NPU、ASIC、FPGA等非GPU加速服務器的市場增速驚人,同比增長率高達182%,市場規模接近7億美元。

盡管全球服務器整體出貨量增速放緩,AI服務器的出貨量卻持續增長。2022年,全球服務器出貨量增長4.8%,達到1360萬臺;2023年預計增速將放緩至1.5%。根據TrendForce的數據,2023年AI服務器的出貨量預計將超過120萬臺,占全球服務器總出貨量的近9%,年增長率高達38.4%。預計到2026年,AI服務器的出貨量將達到237萬臺,占比提升至15%,年復合增長率(CAGR)預計保持在25%左右。

AI服務器采用異構架構,能夠根據不同應用的需求靈活調配算力,為不同場景提供定制化的計算支持。根據處理器類型,AI服務器可分為CPU+GPU、CPU+FPGA、CPU+ASIC等組合。GPU依然是數據中心加速的首選芯片,但非GPU芯片(如NPU、ASIC等)逐漸占據了一席之地。根據IDC預測,2025年非GPU芯片的市場份額將超過20%。在性能方面,ASIC在某些特定應用場景中表現突出,但其可編程性和靈活性較弱;而GPU則在深度學習訓練和通用場景中更具優勢。

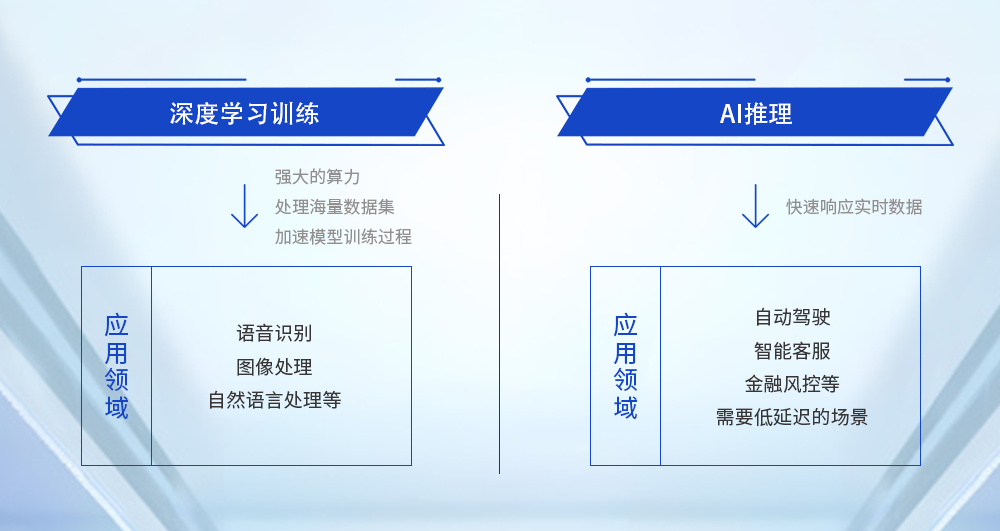

按照用途分類,AI服務器可分為訓練型和推理型。訓練型服務器通常對存儲、帶寬和算力要求極高,常采用8-GPU設計;而推理型服務器則對算力的需求較為靈活,依據不同業務場景,可搭載GPU、NPU或CPU等不同芯片,甚至通過PCLe接口的AI加速器來實現推理任務。

粵公網安備 44030502008261號

粵公網安備 44030502008261號